L’IA souhaite se rappeler de vous, mais cette quête de l’intimité technologique est-elle une bonne nouvelle ?

OpenAI, la société éditrice de ChatGPT vient d’annoncer que son célèbre modèle d’intelligence artificielle allait désormais avoir de la mémoire. Quels sont les impacts pour les utilisateurs ?

/2024/09/14/nicolas-arpagian-66e5be37c179f515361798.png)

/2025/04/26/openai-680d15a070d55891146240.jpg)

Jusqu'à présent, ChatGPT conservait assez peu d’informations de ses interactions avec les utilisateurs. Les éléments étaient notamment stockés le temps de la session de consultation afin de permettre une discussion suivie sur le même sujet. C’est ce qui nous donne l’illusion que nous interagissons avec un interlocuteur qui nous comprend et répond de manière plutôt cohérente à chacune de nos questions. Il gardait également des éléments relatifs aux thèmes et au style de la conversation.

Avec sa prochaine mise à jour, ChatGPT pourra se référer à l’historique de nos dialogues antérieurs. Une version test existait depuis février 2024. La promesse est désormais de rendre possible une personnalisation de notre relation avec ce service d’IA, puisqu’il adaptera ses réponses et ses formulations en fonction de l’historique des échanges précédents.

Les Européens devront patienter

On doit apporter deux précisions de taille : cette fonctionnalité sera d’abord appliquée aux comptes payants (Plus et Pro). Ensuite, réglementations européennes obligent, il n’est pas encore prévu qu’elle soit disponible en Europe dans sa forme actuelle.

Au-delà de ChatGPT, on retrouve cette tendance à enregistrer l’ensemble des interactions chez les autres acteurs du secteur de l’IA comme DeepMind de Google ou Claude de la société Anthropic. Ils cherchent tous à transformer un usage ponctuel pour répondre à une question isolée comme on le ferait avec un moteur de recherche, un assistant personnel qui connaît nos centres d’intérêt, notre style d’expression et les échéances qui nous concernent.

Entretenir une intimité numérique

On revient au principe du profilage individuel par l’analyse des données et des traces laissées lors de notre consommation de services numériques. Cette hyperpersonnalisation est évidemment ambivalente : nous apprécions d’avoir une IA qui nous comprenne, adapte ses explications à notre cas particulier et intègre nos contraintes dans ses réponses et ses propositions.

Mais cela signifie que la plateforme concentre sur la durée une masse d’informations diverses nous concernant. Une sorte de portrait impressionniste qui détaille tout ce qui constitue notre personnalité.

Outre le fait de se voir ainsi mis en fiche, peut-être qu’à force de connaître nos priorités et notre perception du monde environnant, l’IA va orienter ses suggestions. Et que celles-ci vont finir par être celles qui nous plaisent, mais qui ne sont pas forcément celles qui nous sont utiles. Une sorte d’enfermement intellectuel opéré par l’algorithme qui occulte les options qui pourraient, selon lui, ne pas nous convenir. Une façon de créer et d’entretenir des biais cognitifs qui peuvent conduire finalement par pénaliser son utilisateur.

Faire le tri parmi les souvenirs de l'IA

Dans le cas de ChatGPT, la société dirigée par Sam Altman laisse la possibilité à ses clients d’accéder aux éléments enregistrés. Pour le cas échéant, les identifier, les modifier voire les supprimer. La mémoire en question pouvant même être désactivée. Mais il lui faudra donner des gages sur la réalité de ces tris ou de ces retraits.

Car d’autres constructeurs ont par le passé été pris en flagrant délit de promesse non tenue quant à leurs engagements de respecter les exigences de leur clientèle. Par exemple lorsqu’Alexa, l’enceinte connectée d’Amazon, captait bel et bien les conversations environnantes à l’insu de ses propriétaires malgré les engagements pris officiellement.

C’est d’ailleurs notamment en raison des principes du Règlement Général sur la Protection des Données (RGPD), qui encadre les modalités d’exploitation des données personnelles, que ce dispositif de mémoire à longue durée n’est pas, pour l’instant, proposé au sein de l’Union européenne. Son caractère intrusif étant jugé a priori contraire à la conception de la vie privée du Vieux Continent. Des adaptations devront donc intervenir pour se mettre en conformité. Mais cela permet de poser dès à présent le débat sur l’acceptation d’une telle démarche de profilage à l’échelle de la population.

D’autant que de nouvelles plateformes comme Character. AI ou Pi conçu par la société Inflection AI fondée par Reid Hoffman, fondateur de LinkedIn, commercialisent déjà des interfaces d’IA qui revendiquent l'option de coller aux réactions des utilisateurs en exprimant de l’empathie. Une assimilation à l’esprit humain qui exige de collecter un volume de données conséquent, permettant de documenter les traits de caractère des parties prenantes. Là encore se pose la question de l’équilibre entre la personnalisation souhaitée et la mise en fiches de notre tempérament. Un niveau "d'intimité technologique" acceptable qu’il convient d’apprécier et qui appartient à chacun.

À regarder

-

Tornade meurtrière : scènes d'apocalypse dans le Val-d'Oise

-

Nicolas Sarkozy : premier jour en prison

-

L'OMS alerte sur la résistances aux antibiotiques

-

Les frères Lebrun, du rêve à la réalité

-

Que disent les images de l'incarcération de Nicolas Sarkozy ?

-

Algospeak, le langage secret de TikTok

-

Une Russe de 18 ans en prison après avoir chanté des chants interdits dans la rue

-

Cambriolage au Louvre : d'importantes failles de sécurité

-

"Avec Arco, on rit, on pleure..."

-

Wemby est de retour (et il a grandi)

-

Arnaque aux placements : la bonne affaire était trop belle

-

Une tornade près de Paris, comment c'est possible ?

-

La taxe Zucman exclue du prochain budget

-

Un ancien président en prison, une première

-

Normes : à quand la simplification ?

-

La Terre devient de plus en plus sombre

-

Cambriolage au Louvre : d'importantes failles de sécurité

-

Louis Aliot, vice-président du RN, et les "deux sortes de LR"

-

Nicolas Sarkozy incarcéré à la prison de la Santé

-

Décès d'une femme : les ratés du Samu ?

-

Louvre : cambriolages en série

-

Grues effondrées : tornade meurtrière dans le Val d'Oise

-

De nombreux sites paralysés à cause d'une panne d'Amazon

-

Hong Kong : un avion cargo quitte la piste

-

Quand Red Bull fait sa pub dans les amphis

-

Ces agriculteurs américains qui paient au prix fort la politique de Trump

-

ChatGPT, nouveau supermarché ?

-

Eléphants : des safaris de plus en plus risqués

-

Concours de vitesse : à 293 km/h sur le périphérique

-

Églises cambriolées : que deviennent les objets volés ?

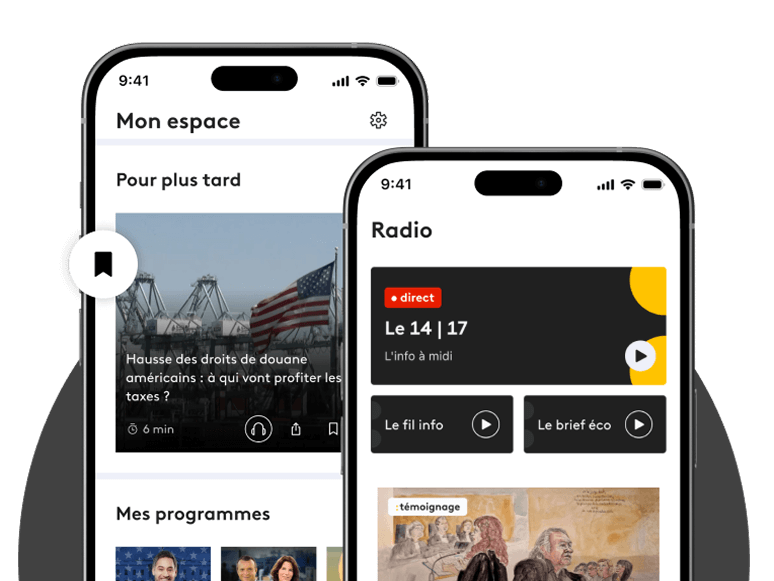

/https%3A%2F%2Fapi.radiofrance.fr%2Fv1%2Fservices%2Fembed%2Fimage%2F20b0887f-2e0b-43e1-a1a4-a37e10c30dfb%3Fpreset%3D400x400)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F14%2Ff6%2F0a%2F22791259-1a74-488c-936f-48a91332c2ba.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fdf%2F40%2Fd9%2F8dd7b394-d611-4b2a-8672-d6bc81bdeeca.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F8e%2Fa4%2F67%2F08ed7167-3a5d-4cc0-9e06-db0a8609ff06.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Faa%2F54%2Ff0%2F7d9cdd65-670a-43f0-ab96-a0267dbc1808.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F41%2Fb6%2F3d%2Fc440633e-cd38-4815-9f16-4db6565d7bd9.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F0f%2F51%2F1d%2F67dd7dfd-1825-42a0-a214-850be94e1ad5.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F68%2F5b%2F32%2Fca0347c7-58b0-4990-9d0a-9e5edb8b55e0.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fed%2F10%2Fa9%2Ff6270e52-b473-43c7-8901-6649908d1884.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fdd%2F2d%2F1c%2F623830c2-6ea5-4eed-9daf-fde57b894f2e.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F1a%2F1e%2F80%2Fe588bfda-e9e2-4c4f-b074-c9aca4b06db1.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F7e%2Fd9%2Ff7%2Ff955d854-39f4-4973-860a-77ba4702b776.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F3c%2F8f%2Ff2%2F43a7e4c1-c589-4fe3-af10-6c4ac9964734.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Feb%2F76%2Fc1%2F2d860025-013b-43e2-807e-a3630147eb35.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F57%2F25%2F59%2Fb31dae06-ab45-40bf-8b52-2a99d52ab711.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F72%2Faf%2F8b%2Fc74b50cf-aa22-4786-91e7-c9b7921f5d26.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fbd%2F41%2Fbb%2F64cf9351-7b0f-4e71-8b0c-18caf04b2d40.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fab%2F0e%2F96%2Fcda1dd9c-274d-4e24-b344-26cd246247c8.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fed%2F3e%2F47%2F067ab707-284d-496a-a640-a4302bc9bfb3.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F9f%2F73%2Fad%2F0abe1156-cbbc-4ddc-8fa5-d558ecada9e8.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Ffb%2F1a%2F5d%2Ff3cf5f95-a67e-43c6-8735-a5d5ae149240.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F6b%2F94%2F2f%2Fd63beb1c-8656-4f6b-aba5-82691125a8f8.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F91%2F96%2Fba%2F24611244-94d4-4a26-b9ed-47f37d2dd025.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F8d%2F26%2F3d%2F2547be98-f488-428d-b490-e8bde56ecc82.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fa7%2F2a%2Ff3%2F51d5bd1c-be94-4cb6-ac75-c0f048e11265.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F43%2Fa9%2F92%2F342dc899-98ad-4ab8-bbad-22a9dbddce0f.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Faa%2Fe5%2F01%2F9a2fb762-cb18-468e-b98e-55d1a5786f3e.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F2a%2Fb8%2F68%2F3f1d6c98-fb47-4e8d-85c5-05904bcfee0b.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F6b%2F95%2Fd5%2F1b406f60-8004-4a1d-ae55-47db03819b24.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F86%2Fe4%2F6e%2F576799f6-7d24-48dc-95ed-defe358b3e9a.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F06%2F5b%2F84%2Ff04bc47a-86b6-4fe0-a428-635fba6aefdf.jpg)

Commentaires

Connectez-vous ou créez votre espace franceinfo pour commenter.

Déjà un compte ? Se connecter