Face à la surabondance d’informations automatisées, Wikipedia revendique la priorité accordée à la supervision humaine

La plus importante encyclopédie mondiale en ligne souhaite donner la priorité à l'intelligence artificielle pour aider ses rédacteurs à vérifier l'information plutôt que pour produire des articles supplémentaires.

/2024/09/14/nicolas-arpagian-66e5be37c179f515361798.png)

/2025/05/10/ibpremiumthree582279-681f2792a939a639917648.jpg)

La facilité offerte par l’IA générative pour écrire des textes pose la question de la qualité et de la véracité des informations accessibles sur Internet. Un sujet qui préoccupe les animateurs de la première encyclopédie mondiale en ligne, Wikipedia.

Pour rappel, l’institut Médiamétrie indiquait qu’en décembre 2024 Wikipédia est le 8e site le plus visité en France, avec 30.350.000 visiteurs uniques par mois et 4.025.000 visiteurs uniques par jour. Cette encyclopédie en ligne, fondée en 2001, est gérée par la Fondation Wikimedia. Face aux mutations technologiques des deux dernières décennies, les animateurs de cette communauté mondiale – largement fondée sur le bénévolat de ses quelque 300.000 contributeurs mensuels – analysent régulièrement les évolutions technologiques qui affectent cette publication qui rassemble plus de 58 millions d’articles.

Des IA génératives potentiellement hyperproductives

L’IA générative se caractérise par l’emploi de modèles de langage qui permettent d’élaborer via des algorithmes des textes, des images, des vidéos ou des compositions sonores. Une faculté à fabriquer des contenus de manière entièrement automatisée.

Avec à la clé des risques de manipulation délibérée de l’information mais aussi d’hallucination involontaire. C’est le cas quand l’IA rédige des explications péremptoires mais erronées à partir de données diverses.

Un lecteur non averti pourrait se laisser tromper par ces affirmations qui donnent l’illusion d’être étayées et véridiques.

Une position fondée sur une consultation de la communauté

Dans l’esprit de sa démarche collaborative, la Fondation a conduit de juin 2024 à février 2025 une discussion en ligne avec ses contributeurs à ce propos. Notamment sur la prise en compte du décalage qui existe entre rapidité de la création de contenus mécanisés et la vérification des informations, qui demeure lente et coûteuse. La conclusion de ces travaux est que – dans le cadre de Wikipedia – l’IA doit être utilisée en priorité pour aider les éditeurs du site à s’assurer de l’intégrité des articles plutôt qu’à fabriquer automatiquement des contenus supplémentaires.

Elle peut leur servir pour prendre en charge des tâches répétitives afin de libérer du temps pour conduire un travail encyclopédique de fond comme la discussion de sujets complexes et la recherche de consensus. Soit une priorité assumée accordée aux rédacteurs humains, conscients que les avancées technologiques peuvent remettre en question ces considérations sur leur mode de travail.

Cette politique a vocation à s’appliquer du 1er juillet 2025 au 30 juin 2028. Et ces concepteurs prévoient de faire le point une fois par an sur les éventuelles ruptures techniques qui pourraient survenir, afin le cas échéant d’adapter leur manière de piloter la gestion éditoriale de Wikipedia.

À regarder

-

Vol des bijoux au Louvre : sept minutes pour un casse spectaculaire

-

Au cœur de la traque des migrants

-

Mouvement "No Kings" aux États-Unis : sept millions d'Américains sont descendus dans les rues contre Donald Trump

-

Allocations familiales : vers un coup de rabot ?

-

Un braquage a eu lieu au Louvre dimanche matin à l'ouverture

-

Avions : quand des batteries prennent feu

-

Affaire Epstein : le prince Andrew renonce à son titre royal

-

Grandir à tout prix

-

Cédric Jubillar : 30 ans de prison pour meurtre

-

Mal de dos : comment le soigner

-

Faire des têtes au foot, c'est stylé, mais...

-

En Chine, le plus haut pont du monde est devenu une attraction touristique

-

Quand t’es collé en forêt

-

À Marseille, la Bonne Mère retrouve sa couronne

-

Meurtre de Lola : ce qu’il s’est passé

-

Chili : un miracle dans le désert

-

Faux diplômes : tricher pour se faire embaucher

-

Vignes : des algues pour remplacer les pesticides

-

Du Maroc au Népal, en passant par Madagascar, la génération Z structure ses luttes sur Discord

-

À Londres, le café c'est dans les toilettes

-

De la propagande russe dans nos infos locales

-

Ordures ménagères : une taxe toujours plus chère

-

Temu, Shein... ça va coûter plus cher ?

-

C'est très compliqué dès qu'on parle de la France

-

Départ anticipé d’E. Macron : “La seule décision digne qui permet d’éviter 18 mois de crise”

-

Donald Trump : le Venezuela dans sa ligne de mire

-

Hommage à Samuel Paty : des minutes de silence "inutiles" pour sa sœur.

-

Avion low cost : payer pour incliner son siège

-

Otages français en Iran : l'appel de détresse de leurs familles

-

Cédric Jubillar : ses défenseurs passent à l'attaque

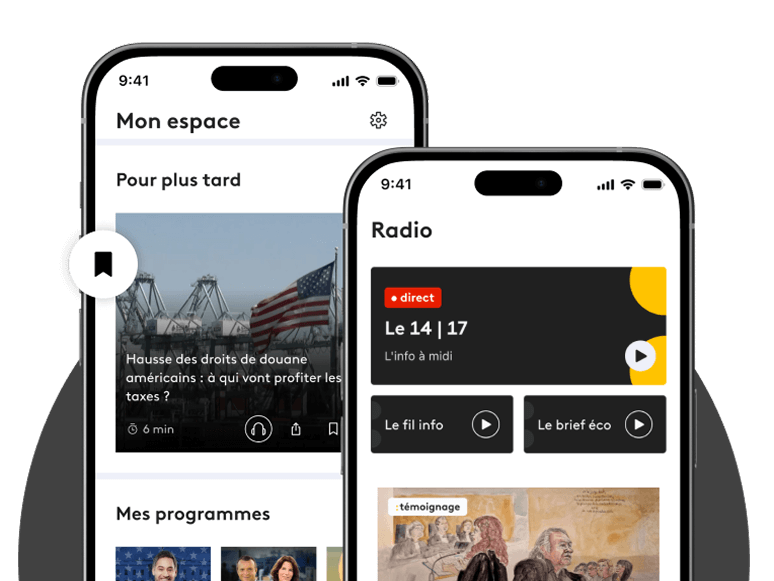

/https%3A%2F%2Fapi.radiofrance.fr%2Fv1%2Fservices%2Fembed%2Fimage%2F20b0887f-2e0b-43e1-a1a4-a37e10c30dfb%3Fpreset%3D400x400)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fcf%2F1c%2Fe4%2F544e5ca9-6524-4b14-801f-7d9974b9c212.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F02%2F97%2Fe7%2F7d4ce141-09e4-440f-8da4-7376d0a86db6.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F67%2Fbf%2Fa0%2Fcf393d05-f10a-4078-af61-ac6449e9c0df.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F32%2F4f%2F8d%2Ff096cd74-1f5a-4396-9bc2-cb31eeb14b0b.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F52%2F58%2F46%2F95779789-4845-4779-ab4b-6f319a8ff4a8.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F70%2F82%2F35%2Fc8089adb-20fb-478f-bca1-57149e59697f.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F55%2F31%2F3b%2F977c063e-7b60-43a5-a5e8-11ee0f290228.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F77%2F82%2Fff%2F85219a6c-d89b-4a1e-a229-4151f50d0e49.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fd4%2Fbb%2F82%2F9dc09235-fe3e-4b31-b5ba-9d220f70ab95.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F78%2F39%2Fb2%2F8d2da375-6e71-4497-8ec0-e669629347d7.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fd1%2F37%2F9b%2Fedbbb24b-ab1b-46e5-9880-d811f1ea4cb2.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Ff1%2F07%2F42%2F32af65ba-9876-4bb1-9330-2f2d35f65e8b.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F40%2F70%2Fcc%2Ff5aea6ed-4d5b-4590-bc95-8c8ad06fb155.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F19%2F3b%2F59%2Fb08505fa-8dc7-464b-8e5b-196410e692e4.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F3a%2F22%2F56%2F67e7dcab-59dc-4fa4-aa7c-68bf8883af59.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F58%2F20%2F21%2Fa4c2cc71-66a3-4818-bc48-bdc531317ab3.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fa5%2F01%2F2a%2F1d167be4-30c8-4310-bbfc-4f1ba688346b.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F15%2F6e%2Fe7%2Fe136e213-b071-4820-9ace-332bfd383b90.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F8c%2Ffc%2Fdc%2F864a40ac-8d9f-4df0-aefb-c1f479789c44.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fb4%2F57%2Fc9%2F2bd3027b-6454-4abf-b635-07d474f00f7a.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fac%2F36%2Fbc%2F64fd4096-2d71-4f69-991c-322c40c5c21f.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F79%2F49%2F14%2F6c0e58b2-2fe9-4385-8dd8-800fa8937c06.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F7b%2Fad%2Fe8%2Fe892c679-106d-47ed-8930-ba76d1d068d9.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F1d%2F0e%2F9b%2F054094ea-d018-4107-87ff-07bddc57119a.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F35%2F21%2Ff4%2F68ba22ea-0ef2-4d86-a18d-64425a2fda5a.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F38%2F97%2F03%2Fde9489b2-b5e9-4125-9038-0c2cf501e682.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F3b%2F62%2Fc5%2F1e197f36-96d0-4b0b-a19c-60b2bc29fef6.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F8f%2F16%2Ffd%2Fccc3f41c-6729-4f9c-815f-2e597cab71ca.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fa8%2F9d%2F30%2F300cb9d4-5415-4d41-92c2-f438b9ce8967.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F01%2F43%2Fa5%2F65c4f25d-b2cb-4f3a-aec0-3e97a36f7d09.jpg)

Commentaires

Connectez-vous ou créez votre espace franceinfo pour commenter.

Déjà un compte ? Se connecter