:

Enquête franceinfo

"La première limite, c'est de garder le contrôle" : comment les journalistes s'approprient l'usage de l'intelligence artificielle

Le secteur des médias n'est pas épargné par la progression de l'intelligence artificielle. Dans les rédactions françaises, son utilisation se fait dans un cadre strict et sans remplacer le travail du journaliste.

/2025/01/13/080-hl-rmilani-2308047-6784f31098da5135323410.jpg)

Alors que Radio France organise Médias en Seine, mardi 14 janvier, franceinfo s'interroge sur la manière dont les radios et les journaux apprivoisent l'intelligence artificielle. Si les possibilités offertes par l'IA sont vertigineuses, son utilisation doit se faire avec une extrême prudence et la garantie de garde-fous.

Certains outils développés, ces dernières années, sont tout simplement surprenants. Il est, par exemple, possible de cloner des voix à l'identique et de leur faire dire absolument ce qu'on veut, au point de ne plus discerner la fiction de la réalité et de tromper l'auditeur. Ce ne sont pas les méthodes utilisées par franceinfo. Les voix diffusées à l'antenne sont toutes réelles, prononcées par des humains, depuis les studios de Radio France ou enregistrés par des reporters ou des techniciens sur le terrain.

Une IA animatrice de radio

Mais ailleurs dans le monde, certains médias ne sont pas aussi regardants. Aux Etats-Unis, par exemple, la radio locale de Portland, dans l'Oregon, Live 95.5, a cloné la voix d'Ashley, une de ses animatrices. Celle-ci continue de parler au micro, une partie de la journée, et puis c'est sa version IA qui prend le relais. La chaîne estime, entre autres, que cela permet à l'animatrice de se concentrer sur d'autres tâches plus administratives sur ses horaires de travail.

Certains médias sont même 100% conçus par l'intelligence artificielle. Récemment, l'artiste Will.i.am, ancien membre des Black Eyed Peas a lancé l'application FYI. Par thématique (politique, culture, sports...), l'utilisateur peut trouver les dernières actualités racontées par une voix générée par l'IA. Des actualités non exhaustives et qui sont une agrégation d'informations piochées directement sur internet. Cela pose la question de la transparence, de la vérification des sources... Même lorsque la technologie est extrêmement bien développée. Il y a de quoi douter de la fiabilité des informations relayées.

"Ce n'est pas l'IA qui va écrire les articles à notre place"

Ce n'est évidemment pas comme cela qu'est traitée l'information à Radio France. Pour autant, comme dans de nombreux médias dits "de confiance", les journalistes ne s'interdisent pas d'avoir recours à certains outils d'intelligence artificielle pour accomplir certaines tâches. C'est le cas du correcteur orthographique, utilisé pour la rédaction des articles. Des logiciels de retranscription d'interview sont également accessibles si le journaliste le souhaite. C'est ce que font la majorité des rédactions. "Ce sont essentiellement des outils d'éditions. Parfois on ne trouve pas le titre idéal, donc on a des outils qui sont capables de proposer, plus ou moins bien, des titres, détaille Benoît Georges, journaliste en charge de l'implantation de l'IA aux Echos. Mais la base, ce sont toujours des articles que nous avons écrits. Ce n'est pas l'IA qui va les écrire à notre place."

L'objectif ici est d'assister le journaliste, de lui faire gagner du temps... mais pas de le remplacer. Tout ça se fait dans un cadre strict : des chartes d'utilisation de l'intelligence artificielle ont d'ailleurs été élaborées dans la plupart des médias, ces dernières années. La cheffe du numérique aux Echos, Violaine Degas, veille ainsi au respect des grands principes : "La première limite, c'est vraiment de garder le contrôle. Il y a toujours un œil humain, un œil de journaliste, qui viendra valider ce que la fonctionnalité peut produire via l'intelligence artificielle. Ça ne remplace pas du tout le travail du journaliste. L'analyse, le décryptage, l'enquête, l'écriture, l'angle : tout ce que fait un journaliste n'est pas remplacé par ces fonctionnalités."

"Suggérer, inspirer le rédacteur"

C'est d'autant plus indispensable que la technologie n'est pas toujours fiable. "Il peut y avoir des lacunes, il peut y avoir des problèmes de formulation, des problèmes d'hallucination comme on dit... Tout simplement, il va inventer des informations, décrit Stanislas de Livonnière est à la tête du service data et innovation au journal Le Parisien. C'est quelque chose qui n'est absolument pas admissible pour un journaliste. Bien au contraire. Alors, ces outils sont là pour suggérer, pour inspirer le rédacteur, mais surtout pas pour publier automatiquement."

"Le journalisme, c'est trouver de l'information et la vérifier. Ce sont deux choses que, à ce stade, l'intelligence artificielle ne sait pas faire."

Stanislas de Livonnière, chef du service data et innovation au Parisienà franceinfo

Paradoxalement, l'explosion de l'information en ligne générée par l'IA pourrait même, d'après Benoît Georges, ramener les lecteurs vers les médias traditionnels : "Il y a un phénomène que les médias américains appellent l'IA slop, de la 'bouillie d'IA'. Ça ne coûte plus rien de fabriquer des textes qui ressemblent à des articles d'information, mais on se rend compte aussi que l'humain détecte que quelque chose ne va pas, qu'il y a une espèce de rabâchage, de médiocrité des contenus à faible valeur. Paradoxalement, ça crée du désintérêt et on peut espérer que les gens reviennent vers les médias classiques, qui, eux, garantissent une façon de travailler et une déontologie qu'on n'a absolument pas dans l'océan de contenus factices qui tend à envahir les réseaux sociaux et les sites web."

"Une démarche qui part de l'usage"

Le groupe Ouest France travaille sur la question depuis plus de dix ans. David Dieudonné y est chargé de projet. Parmi les lignes rouges à ne pas franchir, l'utilisation d'images générées par l'IA pour illustrer des articles d'actualité : "On n'illustre pas un article avec une image synthétique. On considère que notre travail, c'est l'information. Quand il y a une photo, c'est une véritable photo puisqu'on est dans un environnement strictement informationnel et c'est notre devoir de rendre compte de la réalité." Il en va du contrat de confiance entre le média et ses lecteurs ou ses auditeurs.

Alors, l'adoption de ces outils se fait progressivement, en partant des besoins concrets des journalistes et en collaboration directe avec les équipes, défend David Dieudonné : "C'est vraiment une démarche qui part de l'usage. Un journaliste, par exemple, qui cherche à résoudre un problème qu'il rencontre dans son quotidien, grâce à l'accès sécurisé qu'on lui donne à certains outils, peut créer des petits prototypes lui-même. Ensuite, on regarde ces prototypes sous tous les angles (éditoriaux, juridiques, RSE...) pour comprendre s’ils peuvent être déployés à grande échelle."

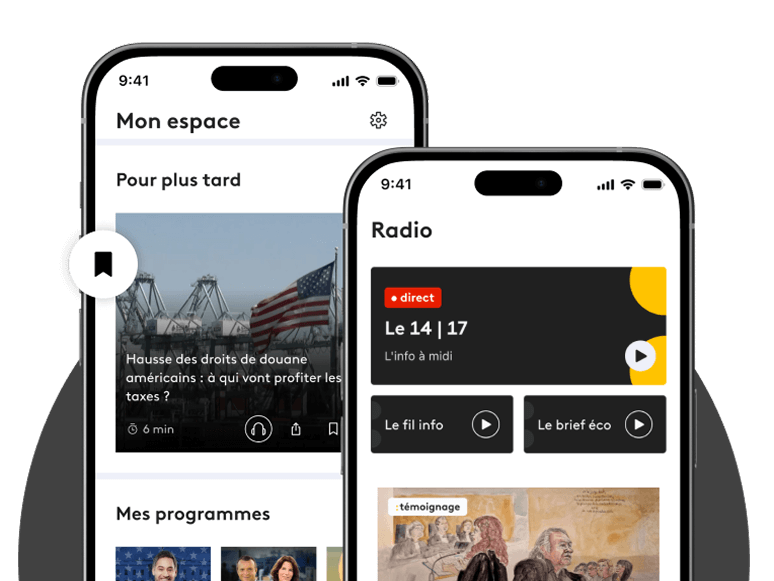

Convaincus que l'IA peut être une véritable aide au sein des rédactions, les médias travaillent continuellement au développement de leurs propres outils et à l'amélioration de nouvelles fonctionnalités. À Radio France, la direction du numérique et de l'innovation est à la pointe. "On regarde tout ce qui se passe en France, à l'international, avance Matthieu Beauval, directeur en charge de l'innovation. Dès qu'un nouvel outil arrive, on va le tester. Nous avons des protocoles qui nous permettent de juger de la pertinence, de l'adéquation des outils avec les besoins éditoriaux des équipes de Radio France."

"On reste très pragmatiques et très responsables"

La direction du numérique et de l'innovation est un peu un laboratoire d'idées : on y fait des tests, des expérimentations, et, surtout, on ne s'interdit rien, glisse-t-on. "Il y a plein de choses qui ne verront sans doute jamais le jour, plein de choses qui verront le jour sous de nouvelles versions parce que les outils ne cessent d'évoluer, confie Matthieu Beauval. Exemple avec tout ce qui concerne l'analyse de documents en masse : des choses qu'un être humain ne peut pas vraiment faire parce qu'il faudrait des jours et des semaines pour analyser plus de deux millions de documents. Pour ça, l'intelligence artificielle nous fait gagner un temps considérable et c'est très utile en termes d'investigation et de vérification de l'information."

Ces expérimentations sont menées avec beaucoup "d'enthousiasme", assure Mathieu Beauval, mais aussi de la prudence pour ne pas tomber dans les travers de la technologie : "On ne peut pas se laisser complètement emporter par ça. On ne peut pas être techno béat, on ne peut pas être techno solutionnistes. C'est génial, c'est extrêmement stimulant et on préfère y voir quelque chose qui repousse les frontières et permettra aux médias, demain, de mieux travailler et aux gens qui fabriquent les médias de mieux travailler. Mais on reste aussi très pragmatiques et très responsables par rapport à ça." Les équipes sont progressivement formées pour faire bon usage de chacun de ces nouveaux outils.

À regarder

-

Wemby est de retour (et il a grandi)

-

Arnaque aux placements : la bonne affaire était trop belle

-

Une tornade près de Paris, comment c'est possible ?

-

La taxe Zucman exclue du prochain budget

-

Un ancien président en prison, une première

-

Normes : à quand la simplification ?

-

La Terre devient de plus en plus sombre

-

Cambriolage au Louvre : d'importantes failles de sécurité

-

Louis Aliot, vice-président du RN, et les "deux sortes de LR"

-

Nicolas Sarkozy incarcéré à la prison de la Santé

-

Décès d'une femme : les ratés du Samu ?

-

Louvre : cambriolages en série

-

Grues effondrées : tornade meurtrière dans le Val d'Oise

-

De nombreux sites paralysés à cause d'une panne d'Amazon

-

Hong Kong : un avion cargo quitte la piste

-

Quand Red Bull fait sa pub dans les amphis

-

Ces agriculteurs américains qui paient au prix fort la politique de Trump

-

ChatGPT, nouveau supermarché ?

-

Eléphants : des safaris de plus en plus risqués

-

Concours de vitesse : à 293 km/h sur le périphérique

-

Églises cambriolées : que deviennent les objets volés ?

-

Quel était le système de sécurité au Louvre ?

-

La Cour des comptes révèle les failles de sécurité du musée du Louvre

-

Cambriolage du Louvre : ces autres musées volés

-

Cambriolage au Louvre : l'émotion et la colère de Stéphane Bern

-

Famille royale : Andrew, le prince déchu

-

Promeneurs, joggeurs : la peur des chiens

-

Vol des bijoux au Louvre : sept minutes pour un casse spectaculaire

-

Au cœur de la traque des migrants

-

Mouvement "No Kings" aux États-Unis : sept millions d'Américains sont descendus dans les rues contre Donald Trump

/https%3A%2F%2Fapi.radiofrance.fr%2Fv1%2Fservices%2Fembed%2Fimage%2Fe13f2a99-c518-41e6-875f-68fe95081ff7%3Fpreset%3D400x400)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F1a%2F1e%2F80%2Fe588bfda-e9e2-4c4f-b074-c9aca4b06db1.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F7e%2Fd9%2Ff7%2Ff955d854-39f4-4973-860a-77ba4702b776.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F3c%2F8f%2Ff2%2F43a7e4c1-c589-4fe3-af10-6c4ac9964734.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Feb%2F76%2Fc1%2F2d860025-013b-43e2-807e-a3630147eb35.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F57%2F25%2F59%2Fb31dae06-ab45-40bf-8b52-2a99d52ab711.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F72%2Faf%2F8b%2Fc74b50cf-aa22-4786-91e7-c9b7921f5d26.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fbd%2F41%2Fbb%2F64cf9351-7b0f-4e71-8b0c-18caf04b2d40.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fab%2F0e%2F96%2Fcda1dd9c-274d-4e24-b344-26cd246247c8.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fed%2F3e%2F47%2F067ab707-284d-496a-a640-a4302bc9bfb3.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F9f%2F73%2Fad%2F0abe1156-cbbc-4ddc-8fa5-d558ecada9e8.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Ffb%2F1a%2F5d%2Ff3cf5f95-a67e-43c6-8735-a5d5ae149240.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F6b%2F94%2F2f%2Fd63beb1c-8656-4f6b-aba5-82691125a8f8.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F91%2F96%2Fba%2F24611244-94d4-4a26-b9ed-47f37d2dd025.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F8d%2F26%2F3d%2F2547be98-f488-428d-b490-e8bde56ecc82.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fa7%2F2a%2Ff3%2F51d5bd1c-be94-4cb6-ac75-c0f048e11265.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F43%2Fa9%2F92%2F342dc899-98ad-4ab8-bbad-22a9dbddce0f.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Faa%2Fe5%2F01%2F9a2fb762-cb18-468e-b98e-55d1a5786f3e.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F2a%2Fb8%2F68%2F3f1d6c98-fb47-4e8d-85c5-05904bcfee0b.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F6b%2F95%2Fd5%2F1b406f60-8004-4a1d-ae55-47db03819b24.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F86%2Fe4%2F6e%2F576799f6-7d24-48dc-95ed-defe358b3e9a.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F06%2F5b%2F84%2Ff04bc47a-86b6-4fe0-a428-635fba6aefdf.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F74%2F5e%2F38%2F179242d7-2cbd-412e-b7d3-922815a3feb5.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fe6%2Fba%2F3b%2F32b5b77d-c642-4583-b199-d422884e8892.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F2b%2F75%2F8a%2F22f25ddf-a702-4bb4-9447-27ee98957614.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fc9%2F78%2F4d%2Ffd79cadf-6798-4eae-9230-dd05dfef64dc.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F82%2F48%2F0d%2Fa8ec2c17-2e47-4915-8a65-5f02b7c1741f.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F8c%2Ff8%2F19%2Fb855940d-681c-4a38-8fc4-e1b900ed0298.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2Fcf%2F1c%2Fe4%2F544e5ca9-6524-4b14-801f-7d9974b9c212.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F02%2F97%2Fe7%2F7d4ce141-09e4-440f-8da4-7376d0a86db6.jpg)

/https%3A%2F%2Fassets.webservices.francetelevisions.fr%2Fv1%2Fassets%2Fimages%2F67%2Fbf%2Fa0%2Fcf393d05-f10a-4078-af61-ac6449e9c0df.jpg)

Commentaires

Connectez-vous ou créez votre espace franceinfo pour commenter.

Déjà un compte ? Se connecter